L’émergence des digital natives a bouleversé les paradigmes éducatifs traditionnels. Ayant grandi dans un monde hyperconnecté, ces jeunes générations maîtrisent les outils numériques, mais présentent également des particularités d’apprentissage qui influencent la manière dont le digital learning doit leur être proposé. Cette transformation engendre plusieurs défis pour les formateurs et concepteurs de digital learning. Décryptons ensemble les conséquences des caractéristiques des digital natives sur les approches du digital learning et examinons comment adapter ces formations pour répondre efficacement à leurs besoins.

Un besoin de formats courts et engageants : l'essor du micro-learning

Les digital natives sont habitués à consommer du contenu en petites portions rapides, qu’il s’agisse de vidéos courtes, de messages sur les réseaux sociaux, ou de mises à jour en temps réel. Ce mode de consommation impacte directement leur capacité à rester concentrés sur des contenus plus longs ou complexes.

Conséquences sur le digital learning

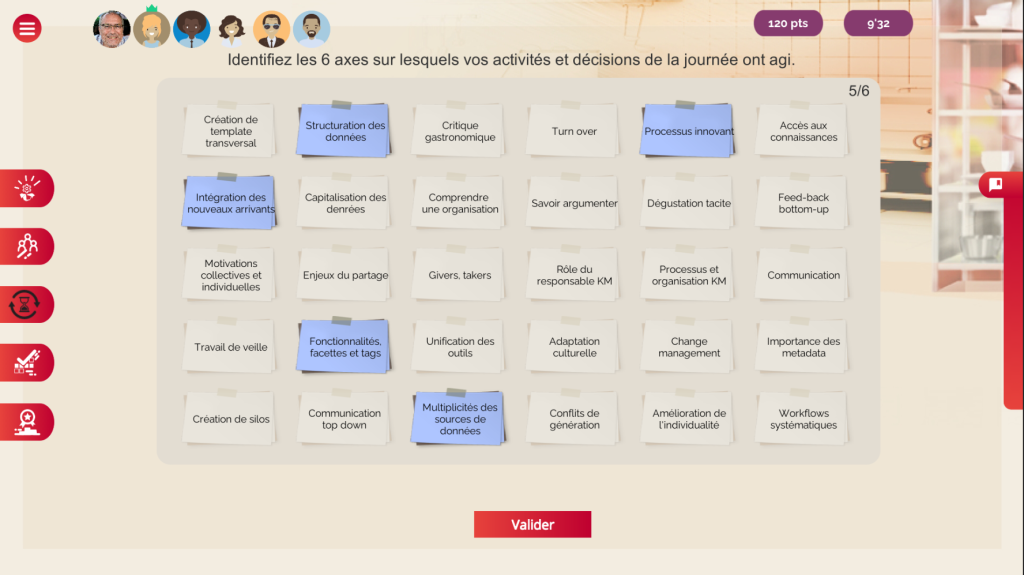

- Fragmentation des contenus : Les formations digitales destinées aux digital natives doivent éviter les formats longs et privilégier le micro-learning, c’est-à-dire des modules courts (de 5 à 10 minutes) qui concentrent les informations clés. La structuration des cours en petites unités permet de maintenir l’attention et de réduire la surcharge cognitive.

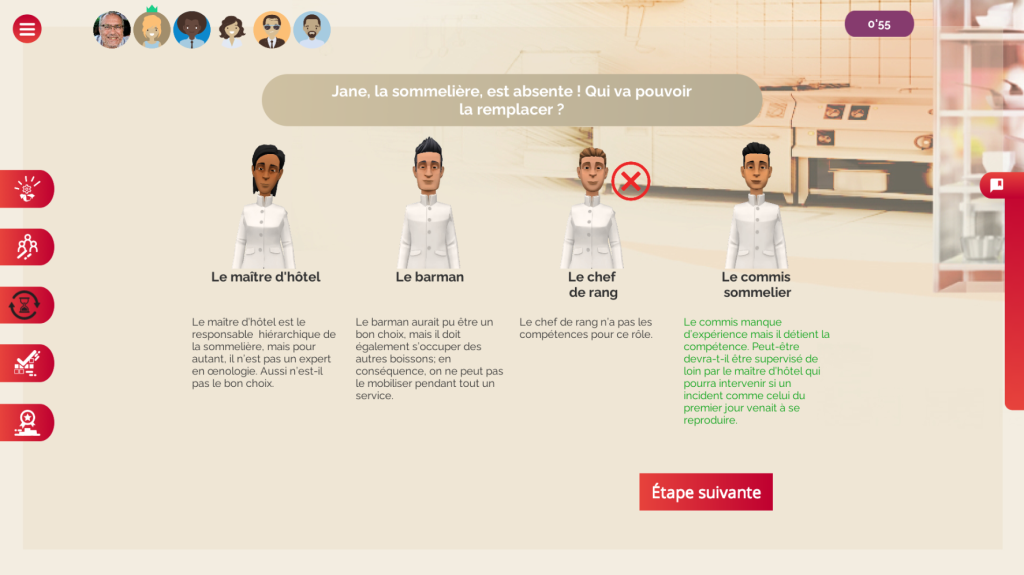

- Interactions fréquentes : Pour retenir l’attention des digital natives, il faut introduire des éléments interactifs tout au long du parcours, comme des quiz rapides ou des exercices pratiques, pour favoriser la rétention des connaissances.

Une concentration fragile : l’importance de l’engagement actif

Le monde numérique hyperconnecté a développé chez les digital natives une tendance à la distraction. Leurs capacités attentionnelles sont fragmentées par les multiples sollicitations numériques, ce qui pose un défi important pour les formations en ligne.

Conséquences sur le digital learning

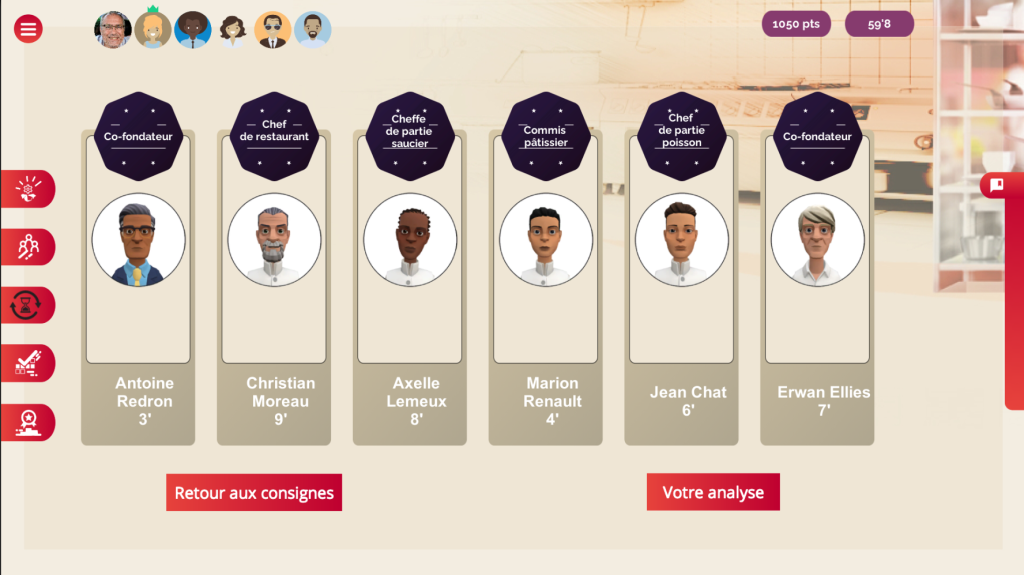

- Gamification et apprentissage ludique : Pour contrer la perte d’attention rapide, il est essentiel d’intégrer des éléments de gamification dans les formations e-learning. L’introduction de défis, de points, de badges ou de systèmes de progression encourage la participation active et maintient l’intérêt tout au long du module.

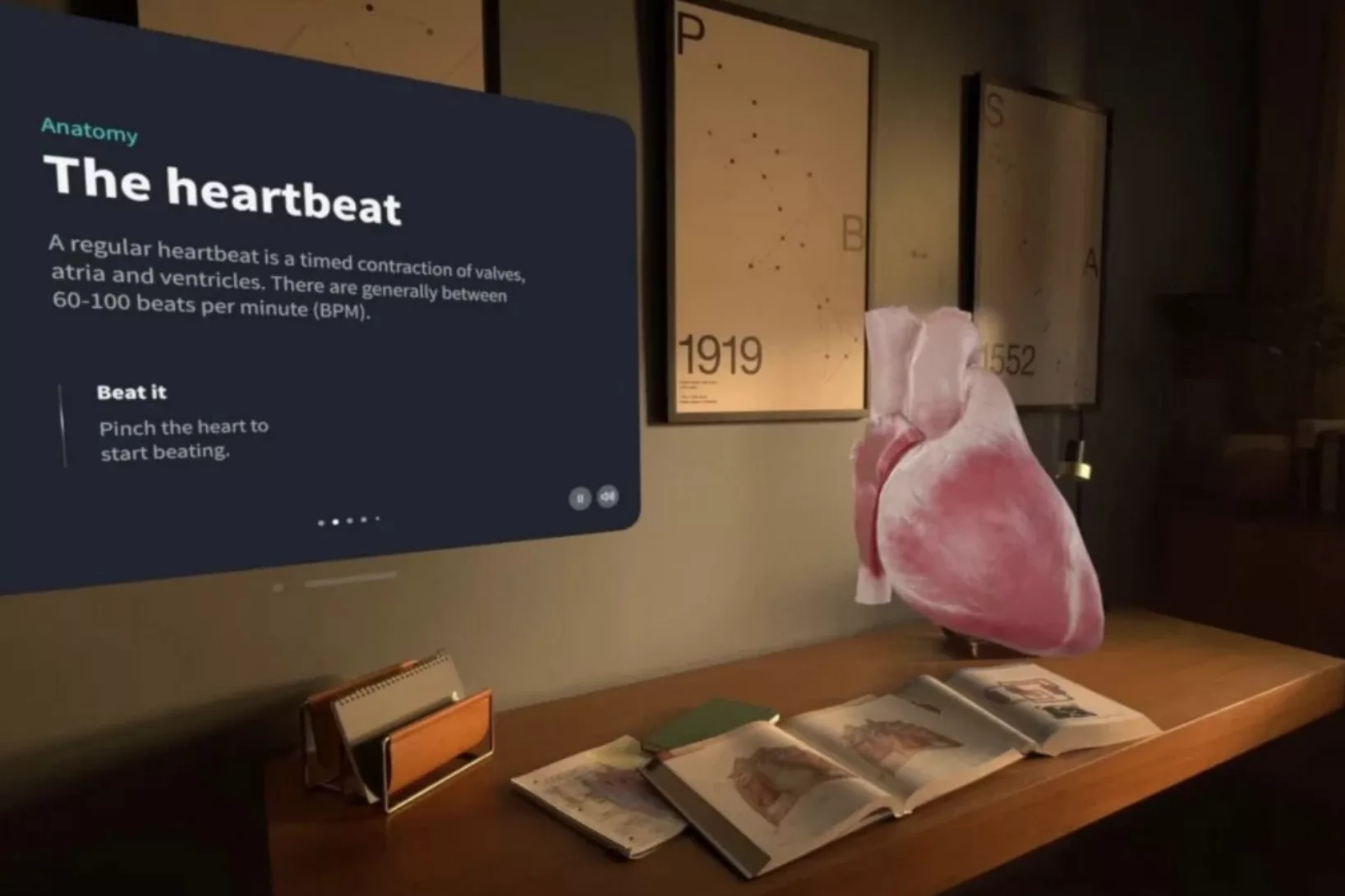

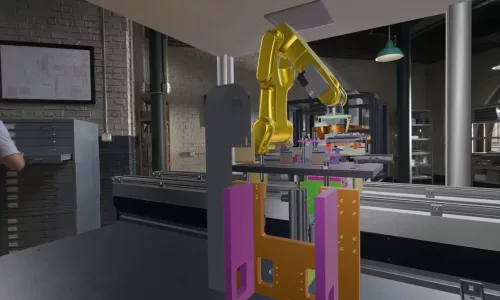

- Engagement multisensoriel : Il est recommandé de diversifier les formats pédagogiques, en intégrant des vidéos, des podcasts et des infographies interactives. Cette approche multimodale stimule plusieurs canaux d’apprentissage simultanément et capte l’attention de manière plus soutenue.

Difficultés de mémorisation : des outils pour renforcer l'apprentissage à long terme

Les digital natives tendent à externaliser leur mémoire, utilisant fréquemment des moteurs de recherche ou des assistants numériques pour accéder rapidement à l’information. Cette habitude de déléguer la mémorisation à des outils numériques peut affaiblir leur capacité à retenir des informations sur le long terme.

Conséquences sur le digital learning

- Feedback instantané : Les systèmes d’apprentissage adaptatifs, qui offrent des retours immédiats à l’apprenant après chaque activité ou évaluation, permettent de renforcer la rétention des connaissances et d’ancrer les apprentissages plus durablement.

- Répétition espacée : Les stratégies d’apprentissage doivent intégrer des techniques de répétition espacée (spaced repetition), qui permettent de renforcer la mémorisation à long terme en révisant les concepts à intervalles réguliers.

Dépendance aux outils numériques : encourager l’autonomie et la réflexion critique

Bien que les digital natives soient à l’aise avec les technologies, ils peuvent présenter une dépendance excessive à ces outils pour résoudre des problèmes, ce qui affecte leur capacité à réfléchir de manière critique ou à planifier leurs tâches de manière autonome.

Conséquences sur le digital learning

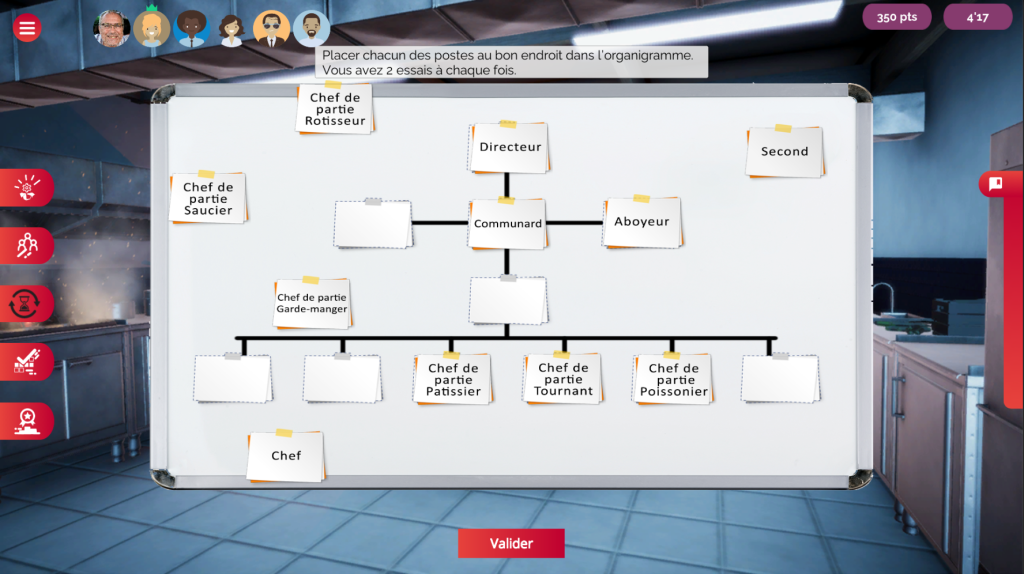

- Problématiques ouvertes et études de cas : Les formations doivent inclure des études de cas et des projets ouverts qui demandent aux apprenants de résoudre des problèmes complexes sans recours immédiat aux outils numériques. Cela stimule leur pensée critique et renforce leur autonomie.

- Encourager l’évaluation des sources : Dans un environnement numérique où les informations sont pléthoriques, les modules de digital learning doivent intégrer des activités qui apprennent aux digital natives à analyser et vérifier la qualité des informations qu’ils consultent. Cela leur permet de développer un esprit critique et d’éviter la désinformation.

Problèmes de planification : intégrer des compétences en gestion du temps

Les digital natives ont grandi dans un monde de gratification immédiate, où la notion d’effort prolongé est parfois diluée. Cette tendance peut affecter leur capacité à gérer leur temps et à planifier leurs apprentissages sur le long terme.

Conséquences sur le digital learning

- Structuration claire des parcours : Les formations en ligne doivent être conçues avec une structure claire, indiquant des étapes et des objectifs bien définis à chaque phase. Des outils de planification intégrés, comme des timelines ou des rappels d’échéances, aident les digital natives à mieux organiser leur apprentissage.

- Enseigner la gestion du temps : Les modules peuvent intégrer des conseils ou des outils sur la gestion du temps (par exemple, des techniques de time-blocking), qui aident les apprenants à organiser leur travail et à structurer des tâches complexes.

Pour réussir à former efficacement les digital natives, le digital learning doit donc s’adapter aux spécificités de cette génération. L’usage du micro-learning, la gamification, les outils interactifs, et l’intégration d’approches multimodales sont autant de leviers pour capter leur attention et favoriser leur apprentissage. Parallèlement, il faut renforcer des compétences parfois délaissées, telles que la mémorisation à long terme, la planification et la réflexion critique, afin de former des apprenants autonomes et capables de faire face aux défis du monde numérique.

En adoptant ces stratégies, le digital learning peut non seulement répondre aux besoins des digital natives, mais aussi les préparer aux exigences du monde professionnel, où les compétences de gestion du temps, d’autonomie et d’évaluation des informations sont de plus en plus cruciales.